Szanowni Państwo, dzisiejszy wykład rozpoczyna cykl spotkań poświęconych sieciom komputerowym LAN.

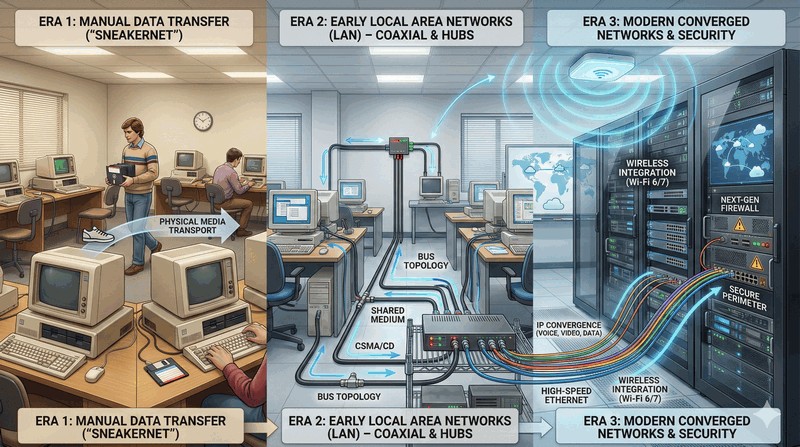

Zrozumienie współczesnych rozwiązań teleinformatycznych wymaga spojrzenia w przeszłość, gdyż wiele

obecnych standardów jest bezpośrednim wynikiem ewolucji historycznych koncepcji. Rozpoczniemy od

omówienia ery komputerów typu mainframe, która zdefiniowała model centralnego przetwarzania danych.

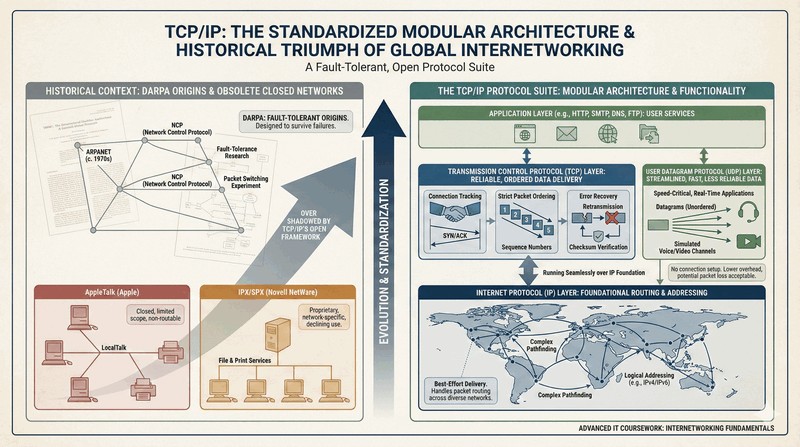

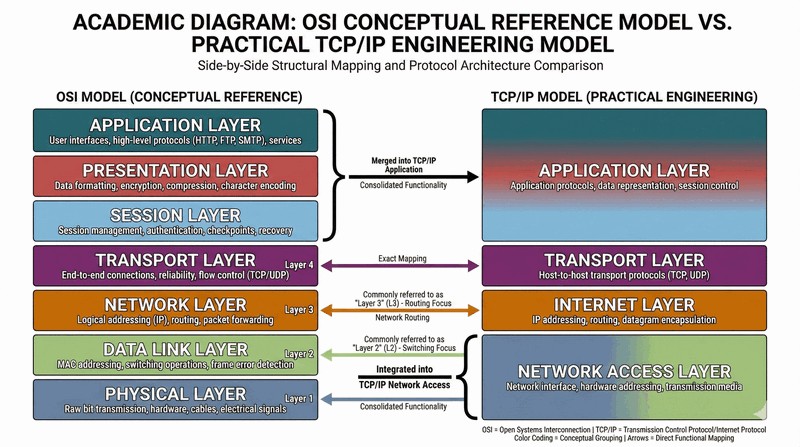

Następnie przeanalizujemy pierwsze globalne sieci oparte na komutacji pakietów oraz rolę protokołów

wojskowych w kształtowaniu Internetu. Celem tego modułu jest zbudowanie solidnego fundamentu

terminologicznego, niezbędnego do dalszej nauki o architekturze TCP/IP. Proszę o skupienie, gdyż

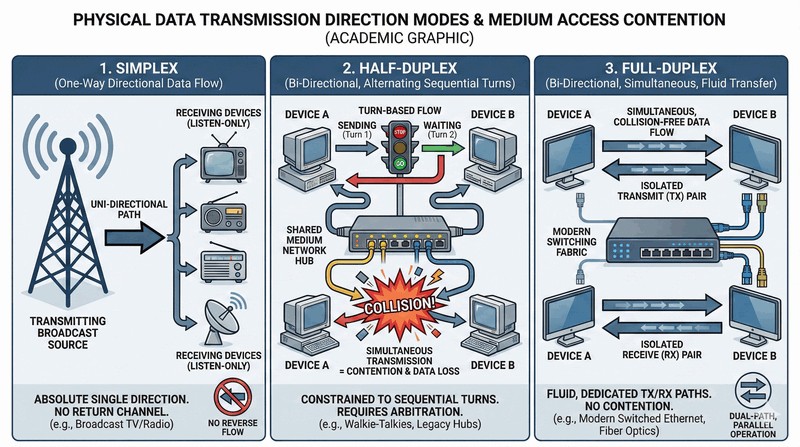

omawiane dziś mechanizmy, choć wiekowe, wciąż stanowią logiczną podwalinę działania najnowszych routerów

i przełączników. Historia IT to nie tylko daty, ale przede wszystkim ewolucja idei, która doprowadziła

do powstania globalnej wioski.